Una nuova realtà economica sta iniziando a prendere piede nell’intelligenza artificiale. È già alla base dei giganteschi data center del settore e un giorno diventerà una regola ferrea per tutte le aziende che utilizzano l’intelligenza generata dalle macchine.

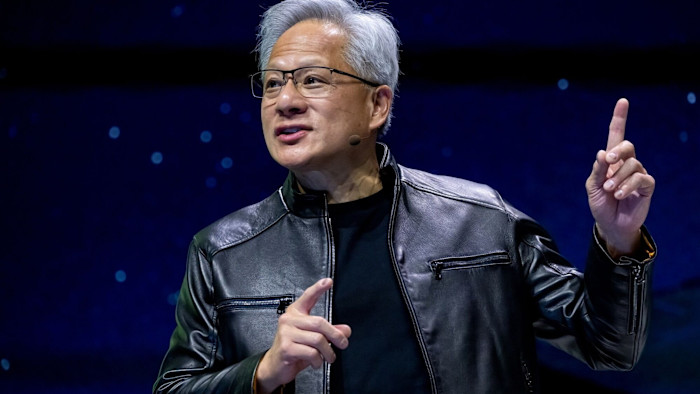

Questo, almeno, secondo Jensen Huang, amministratore delegato di Nvidia, che questa settimana ha promosso fortemente l'idea durante il principale evento tecnologico annuale della sua azienda. La sua teoria aiuta a sostenere il continuo dominio di Nvidia nel settore dei chip. Ma rivela anche quanto lontano deve spingersi l’industria per sostenere una causa più ampia a favore della tecnologia.

L'approccio di Huang all'economia dell'intelligenza artificiale si basa sulla produzione, il consumo e la monetizzazione dei token. Queste sono le unità di output più basilari di modelli linguistici di grandi dimensioni: sono necessari circa 1.300 token per generare 1.000 parole di testo. Il parametro chiave, sostiene, è il costo per token di output. E come input principale nei servizi basati sull’intelligenza artificiale, aggiunge, i token si traducono direttamente in entrate.

Non è difficile capire perché il capo di Nvidia voglia che una Wall Street nervosa si concentri sull’economia dei token. Dimentica le gigantesche spese in conto capitale o il fatto che così tanti concorrenti si mettono in fila per erodere i grossi margini di profitto di Nvidia, sembra dire: finché i chip della sua azienda continuano a produrre token al costo più basso e finché la domanda di token continua a superare di gran lunga l'offerta, allora tutto va bene con il boom dell'intelligenza artificiale.

Come teoria della continua preminenza di Nvidia, sembra convincente. Ma se l’economia simbolica dovesse mai governare il mondo dell’intelligenza artificiale nel modo previsto da Huang, è necessario colmare alcune importanti lacune.

Uno è la mancanza di un chiaro legame tra la produzione di token e la creazione di valore per i clienti. Solo perché il costo dei token sta diminuendo non significa che i servizi creati con l’intelligenza artificiale diventino improvvisamente preziosi o che ciò genererà automaticamente entrate in tutto il settore, come suggerisce Huang.

A complicare questo quadro è il fatto che i nuovi modelli di intelligenza artificiale consumano un numero molto maggiore di token. I modelli di “ragionamento” emersi alla fine del 2024, a partire da o1 di OpenAI, svolgono molto più lavoro per arrivare a una risposta. A questi si aggiungono ora gli agenti, che promettono di automatizzare il lavoro dei colletti bianchi e portare un’esplosione nell’uso dei token – e, per estensione, fatture salate per le aziende che danno ai lavoratori un uso illimitato dell’intelligenza artificiale.

Nvidia e il resto del settore dell’intelligenza artificiale hanno appena scalfito la superficie quando si tratta di mostrare come ciò si tradurrà in entrate per i loro clienti. Nell’ingegneria del software, che ha visto il primo uso diffuso di agenti IA, ci sono stati sforzi per misurare come l’uso dei token è collegato all’output e per utilizzarlo per distribuire i token ai lavoratori. Alla fine, le aziende tecnologiche sognano che l’intelligenza artificiale diventi una parte fondamentale dell’occupazione, con il costo di tutti i colletti bianchi che verrà visto come uno stipendio più un certo numero di token al mese. Per ora è ancora solo un sogno irrealizzabile.

Il secondo tassello significativo che manca nella narrazione di Huang sull'economia dei token emergente è il modo in cui le aziende che producono token, la materia prima da cui tutto dipende, realizzeranno profitti. Se tutte queste “fabbriche di intelligenza artificiale” utilizzano i chip più recenti di Nvidia, potrebbe essere difficile per qualcuno di loro ottenere un vantaggio in termini di costo per token o mantenere un potere di determinazione dei prezzi.

Il forte calo dei prezzi che ha accompagnato il crollo dei costi di produzione dei token sembra confermarlo. Quando OpenAI ha lanciato GPT-4 due anni fa, ad esempio, ha addebitato 33 dollari per 1 milione di token. Oggi costa solo 9 centesimi per i token da 1 milione prodotti dal modello più economico. Ciò può essere positivo per i clienti, ma ha alimentato le preoccupazioni sulla mercificazione.

Tali preoccupazioni non sono affatto nuove. È lo stesso argomento che si è sentito agli albori del cloud computing, quando Amazon Web Services faceva pagare l’accesso all’archiviazione dei dati di base e alla potenza di calcolo. Come potrebbero le aziende cloud realizzare un profitto decente se i servizi informatici venissero ridotti al minimo e venduti come merci come questa? La risposta è stata che questi erano solo i primi componenti di quelli che sarebbero diventati servizi a valore più elevato: piattaforme informatiche su vasta scala su cui i clienti potevano gestire le proprie attività. Non è chiaro se OpenAI e Anthropic saranno in grado di realizzare un trucco simile, ma l’opportunità che hanno davanti è chiara.

Potrebbero esserci altre spiegazioni per gli ottimi margini di profitto del cloud computing. L’azienda è governata da un piccolo oligopolio. Le società cloud hanno anche dovuto affrontare pressioni da parte delle autorità di regolamentazione per ridurre i costi di cambiamento che potrebbero contribuire ad aumentare i loro profitti.

Per ora, non c’è carenza di concorrenza tra le aziende di intelligenza artificiale di frontiera. Il modo in cui ciò si risolverà in futuro contribuirà notevolmente a modellare i profitti del settore.