Le immagini satellitari che sembrano essere state generate o modificate con l’intelligenza artificiale sono state ampiamente condivise sui social media durante il fine settimana, evidenziando i pericoli della tecnologia come potenziale veicolo di disinformazione in tempo di guerra.

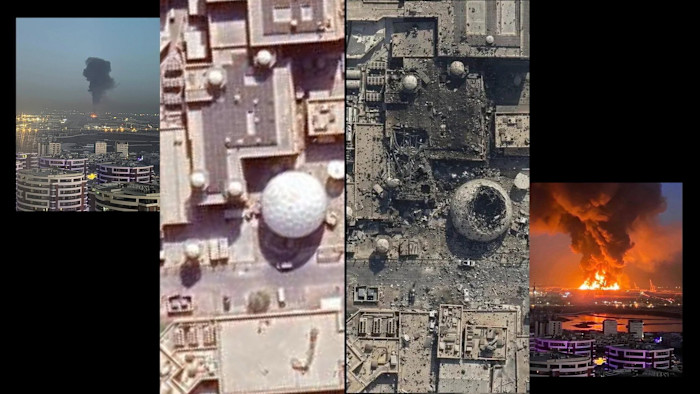

Un'immagine è circolata su X, inclusa in a inviare dal resoconto ufficiale del quotidiano iraniano Tehran Times – mostra un’immagine satellitare che afferma di rappresentare danni a un sistema radar americano in Qatar a seguito di un attacco di droni iraniani.

L'analisi FT rivela che si tratta di un'immagine alterata dall'intelligenza artificiale di un'area del Bahrein. I video verificati dal FT mostrano diversi attacchi nell'area attorno al sistema radar in Bahrein e le immagini satellitari catturate da Planet Labs il 1 marzo confermano che il sito è stato danneggiato.

Ma l'immagine del radar distrutto presenta segni di manipolazione: i veicoli che apparivano nella foto “prima” scattata più di un anno fa rimangono nella stessa posizione, le ombre cadono esattamente con la stessa angolazione dell'immagine precedente e parti della struttura dell'edificio sono state alterate. Le immagini satellitari storiche non mostrano modifiche strutturali al sito negli ultimi anni.

Al momento della pubblicazione, il Tehran Times' il solo post ha avuto quasi 1 milione di visualizzazioni, è stato condiviso migliaia di volte ed è rimasto online per più di 48 ore dopo la pubblicazione. Il FT ha riscontrato casi in cui l'immagine è stata condivisa su altre piattaforme di social media e siti Web.

L’episodio riflette un cambiamento più ampio nella guerra dell’informazione, poiché l’intelligenza artificiale generativa rende più facile fabbricare prove visive convincenti e più difficile per il pubblico distinguere tra documentazione e inganno.

In risposta all'ondata di video falsi che circolano sulla piattaforma, il responsabile del prodotto di X, Nikita Bier, ha pubblicato martedì che la società intensificherà gli sforzi per frenare i contenuti generati dall'intelligenza artificiale. Agli utenti che scoprissero di condividere materiale senza un'adeguata divulgazione verrebbe impedito di guadagnare entrate per 90 giorni e i recidivi sarebbero soggetti a sospensione permanente, ha affermato Bier.

Brady Africk, ricercatore indipendente di intelligence open source e direttore delle relazioni con i media presso l’American Enterprise Institute, ha affermato che le persone tendono a fidarsi delle immagini satellitari come fonte di verità a causa della complessa tecnologia coinvolta nella loro acquisizione.

“Le immagini satellitari possono essere manipolate proprio come le altre immagini. L'intelligenza artificiale ha reso tutto tremendamente più semplice e veloce [it] rappresenta una minaccia significativa per le persone che cercano di ottenere informazioni online”, ha detto Africk. Ha aggiunto di essere preoccupato che il rapido miglioramento di questi modelli possa solo rendere i falsi più difficili da individuare nei conflitti futuri.

La difficoltà nell'identificare un'immagine satellitare manipolata, rispetto a un deepfake di una persona, è la “mancanza di informazioni biometriche”, secondo Henk van Ess, esperto di metodi di ricerca online e autore della newsletter Digital Digging.

“Con una faccia, puoi cercare strani ammiccamenti, struttura della pelle innaturale, orecchie deformi”, ha detto. “Con un'immagine satellitare, stai guardando edifici, strade, terreno – cose che non hanno questi segnali intrinseci. E la maggior parte delle persone non ha idea di come dovrebbe apparire un'immagine satellitare autentica da un sensore specifico a una risoluzione specifica”, ha detto.

“Il cambiamento fondamentale è questo: prima era necessaria un'agenzia di intelligence statale con competenze in Photoshop per falsificare un'immagine satellitare. Ora chiunque abbia accesso a strumenti di intelligenza artificiale disponibili gratuitamente può produrre qualcosa di abbastanza convincente da ingannare gli spettatori occasionali e spostare i mercati. La barriera è crollata”, ha aggiunto van Ess.

Un'altra immagine alterata dall'intelligenza artificiale ampiamente distribuita sembra essere un versione ingrandita e colorata di un'immagine in bianco e nero catturato da Airbus, la compagnia aerospaziale. Non è chiaro da dove provenga l'immagine ritoccata. L'immagine aveva il watermark con il nome di MizarVision, una start-up spaziale cinese che la pubblicava foto satellitari del rafforzamento militare statunitense in Medio Oriente nelle ultime settimane, ma l'immagine non è elencata sulle pagine dei social media dell'azienda.

La pagina ufficiale di MizarVision attualmente contiene un avvertimento sugli account sui social media che affermano di distribuire le sue immagini. MizarVision e il Tehran Times non hanno risposto alle richieste di commento.

Secondo Bo Zhao, professore di geografia digitale all’Università di Washington, l’uso dell’intelligenza artificiale per aggiungere colore alle immagini satellitari può cambiare leggermente il modo in cui le persone vedono la scena, introducendo differenze percepite che potrebbero in realtà non esserci.

“Le immagini in bianco e nero non contengono dettagli e prospettive delle cose o differenze sul terreno”, ha spiegato Zhao. “Con il colore diventa più facile differenziarsi”.

Anche altri media generati dall’intelligenza artificiale sono stati ampiamente condivisi, inclusa un’immagine che evidenzia il presunto danno a una base americana vicino a Erbil, in Iraq. L’immagine migliorata dall’intelligenza artificiale mostra un incendio violento e un’enorme nuvola di fumo e contiene ancora incongruenze strutturali rispetto alle immagini recenti scattate in quel luogo.

UN post in cui affermava di mostrare il corpo dell'estrazione del leader supremo dell'Iran, l'Ayatollah Ali Khamenei, da sotto le macerie è stata condivisa ma non è stata verificata e sembra essere anch'essa generata dall'intelligenza artificiale.

Il conflitto in Medio Oriente non è la prima guerra ad essere colpita dalla disinformazione guidata dall’intelligenza artificiale. C'erano segnalazioni di immagini satellitari false in seguito al conflitto tra India e Pakistan durato quattro giorni lo scorso anno e affermazioni simili sono state avanzate durante il Ucraina-Russia guerra.

“Penso che sia in gran parte una questione educativa e di consapevolezza nel senso di garantire che quante più persone possibile siano consapevoli dei modi in cui i media digitali possono essere manipolati”, ha detto Africk. “Le persone dovrebbero essere molto irremovibili nel trovare fonti attendibili che lavorino sotto gli occhi del pubblico e farlo in modo responsabile”.